Midjourney Video 教程与深度解析:为何它可能改变未来创作方式?

2025年6月,Midjourney正式发布了其首个视频生成模型——Midjourney Video V1。这是一个图像生成工具迈向"动态宇宙模拟"的关键一步,也许看起来只有480P,却可能是我们未来创作方式改变的起点。

🧭 Midjourney Video是什么?从静态到动态的跃迁

与Sora、Kling等AI视频模型不同,Midjourney Video并不支持文本生成视频。你无法通过一段prompt得到一整段动画。但你可以:

- 在Midjourney生成图像后

- 点击"Animate"按钮

- 生成出带有动态效果的视频片段

这是Midjourney所说的"图像转视频"(Image to Video)功能。

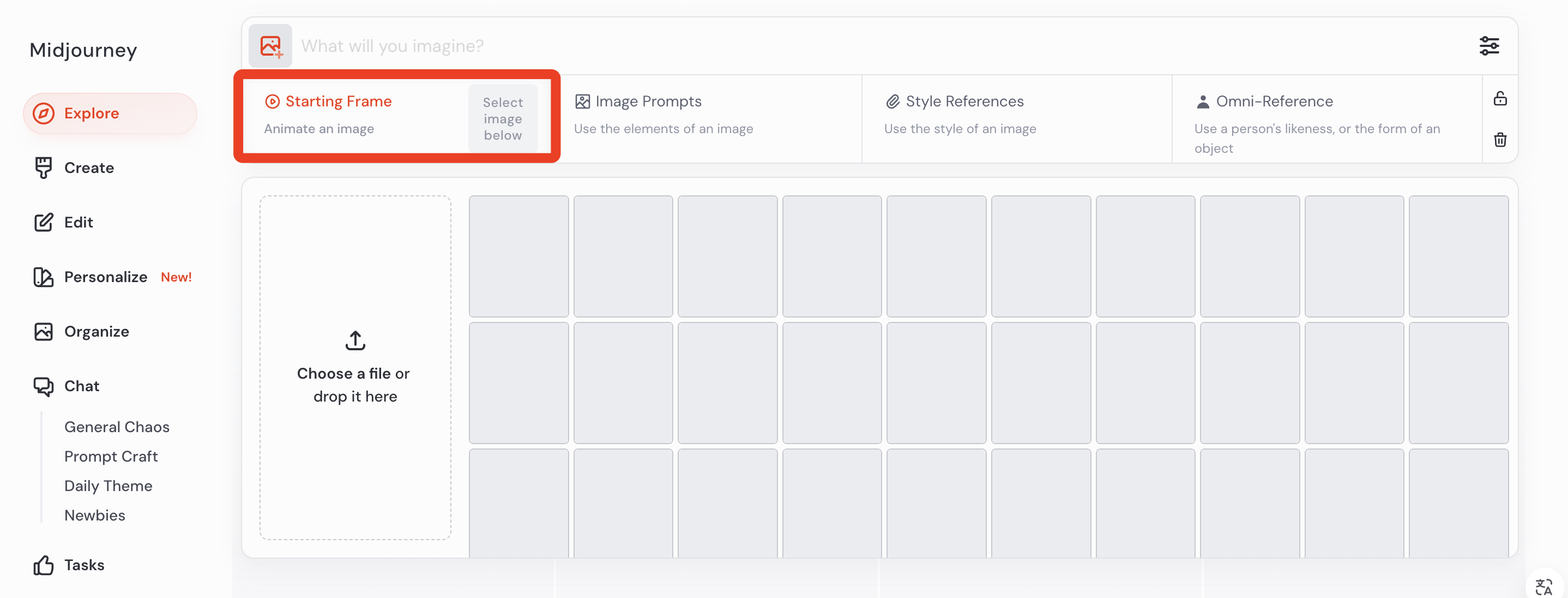

🎬 Midjourney Video的使用方法详解

每次视频生成:

- 默认生成4段视频,每段约5秒长

- 可通过延长按钮最多扩展至21秒:

- 自动延长: 使用原始提示自动延长您的视频。

- 手动延长: 如果您想在延长视频之前更改提示文字,请使用手动选项。这样,您可以在提交更长的视频之前调整或添加新元素。

- 支持两种运动强度:

- 低运动: 适合氛围画面,镜头静止

- 高运动: 适合动作画面,镜头运动强烈

- 可选动画模式:

- 自动模式: 系统根据图像自动编排运动

- 手动模式: 你输入动作提示,自定义节奏与变化

- 分辨率为480P

- 当前仅在Midjourney网站端可用,Discord不支持

- 支持上传外部图像作为起始帧

更多详细信息,请参阅官方Midjourney Video文档。 official Midjourney Video documentation.

✏️ 如何写出优秀的Midjourney Video提示词?

在手动模式下,Midjourney Video对提示的要求与图像大不相同:

✅ 提示词编写三要素:

- 动作动词: walks, turns, rises, glows...

- 时间连接: then, while, suddenly, after that...

- 场景演进: from a forest to a glowing cave...

🎥 示例:

A cat darts across a rooftop, while the moon rises behind it. Camera pans left as a streetlamp flickers.

这样的句子让AI理解:谁在动、怎么动、接下来发生什么。

❌ 避免使用:

- "8K", "HDR", "f/1.8", "Artstation trending"等与视频生成无关的噪声词

- 摄影术语、超高分辨率描述等"安慰剂"提示

Midjourney提醒我们:写视频提示不是写参数,而是在讲一个3秒钟的小故事。

💰 Midjourney Video定价与门槛

Midjourney Video无需额外购买,所有订阅用户均可使用:

- 每段视频的成本 ≈ 一张图像

- 每秒视频 ≈ 一张图像的代价

- Pro与Mega用户可使用Relax模式(不限时长、不加速扣点)

相比市面上动辄几美元/分钟的视频生成服务,Midjourney的策略是高性价比 + 低门槛普及。

🌈 Midjourney Video的优势与短板:真实测评

✅ 优势亮点:

- 风格一致性强: 视频延展部分也能保留原始图像风格、笔触与氛围

- 生成速度快: 4段视频仅需65秒,极大提升创作效率

- 延展稳定性高: 延长至17秒仍然流畅,不会崩溃

- 美学表现优秀: 画面构图与色彩延续了Midjourney图像的顶级水准

❌ 存在问题:

- 提示词理解一般: 在复杂动作、物理逻辑上存在穿模、肢体错位等问题

- 分辨率限制: 目前仅支持480P,虽视觉清晰,但不适合大屏/商业剪辑

🚀 为什么Midjourney Video依然值得关注?

许多人质疑Midjourney Video为什么还停留在480P,甚至没有物理骨骼控制。但他们忽略了一点:

Midjourney的目标并不是打赢"视频模型性能"的军备竞赛,而是构建AI生成世界的感官基建。

这套体系包括:

- 图像生成(已实现)

- 图像转视频(已发布)

- 可交互的3D建模(开发中)

- 实时内容渲染(未来目标)

相比追逐更高清晰度的输出,Midjourney更关注生成速度与时序一致性——这是未来实时世界模拟中最关键的部分。

他们不是在建视频编辑器,而是在建"想象力的入口"。

🧩 Midjourney Video引发的行业连锁反应

Midjourney Video的推出,也引起了不小的震动:

- Reddit等社区反响热烈,创作者已纷纷上传作品

- Disney与Universal对其提起版权诉讼,指控其训练集含有未经授权的角色素材

从图像到视频,版权问题更加复杂。Midjourney的挑战才刚刚开始。

✨ 一句总结:Midjourney Video是一扇门,而不是终点

Midjourney Video的本质超越了技术规格或即时功能。它代表了我们与人工智能互动以创造视觉叙事和动态体验方式的根本转变。

这种前瞻性方法体现了Midjourney正在构建的核心理念:

- 它不追求眼前最强参数

- 它不模仿他人路径

- 它在构建一片崭新领域:让想象力可视化、可移动、可探索

正如文章开头所说,也许多年以后我们会发现:

👉 Midjourney发布的这个"只有480P"的视频模型,是我们通往元宇宙的第一扇门。

资源库

资源库